Die Anruferin klingt wie die eigene Tochter - aber die Stimme ist geklaut. Künstliche Intelligenz (KI) macht betrügerische Schockanrufe noch tückischer, wenn Stimmen geklont werden und nicht mehr von den echten unterscheidbar sind. »Das ist schon ohne großes technisches Knowhow möglich«, meint der KI-Koordinator beim Berliner Landeskriminalamt, Eugen Hofmann.

Deutsche Sicherheitsbehörden rufen nach Werkzeugen der KI, um digitaler Verbrechensausübung nicht länger hinterher zu laufen. »Die Polizei muss dem etwas entgegen setzen«, meint LKA-Mann Hofmann. Vor allem auch die Bearbeitung riesiger Datenmengen soll künftig mit Algorithmen erleichtert werden etwa bei Ermittlungen wegen Kinderpornografie.

Auch Geldautomatensprengern oder Dokumentenfälschern lässt sich aus Forscher-Sicht mit Hilfe von KI auf die Spur kommen. Bislang aber fehlt oft - auch wegen hoher rechtlicher Hürden - der Praxiseinsatz bei der Polizei. Eine klare Ausrichtung für die Zukunft war bislang kaum erkennbar.

»Flickenteppich« in Sachen KI bei den Länderbehörden

»Es wird Zeit, dass es anfängt«, sagt der Informatiker Andreas Dengel. Er ist Geschäftsführender Direktor des Deutschen Forschungszentrums für Künstliche Intelligenz (DFKI) in Kaiserslautern, das mit dem Bundeskriminalamt (BKA) und dem LKA Rheinland-Pfalz kooperiert und KI-Systeme für Polizeiermittlungen testet. Bislang besteht aus Sicht des KI-Experten Dengel ein großer Flickenteppich bei den Polizeibehörden der Länder. »Es müsste einen nationalen Polizeibeauftragten geben, der eine KI-Strategie entwickelt.«

Polizei will Schuhabdruck von Kriminellen mit KI analysieren

Einige Beispiele für Forschungsprojekte und KI-Tests für die Polizeiarbeit:

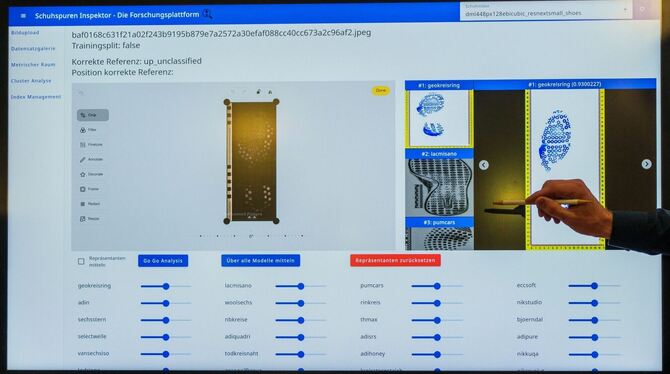

Wenn Geldautomaten-Sprenger, die 2023 in Deutschland mehr als 450 Geräte zerstörten, Schuhabdrücke hinterlassen, kann aus Sicht Dengels eine eigens dafür trainierte KI zum Einsatz kommen. Die Muster ließen sich dann bestimmten Schuhtypen zuordnen. Bislang seien bereits einige Tausend unterschiedliche Schuhabdrücke bundesweit gesammelt, so Dengel. Das Ziel: Täter am Schuhprofil zu identifizieren. Das System stehe kurz vor der Einführung, er hoffe noch 2024, sagt Dengel.

Einsatz bei Dokumentenfälschungen und auch beim Fußball?

Mit neuen Verfahren kann die Polizei laut Deutschem Forschungszentrum in Kaiserslautern auch gefälschten Dokumenten auf die Spur kommen. Ein KI-System könne dabei die minimalen Unterschiede bei Druckern erkennen.

Getestet werden zudem beispielsweise im Süden Deutschlands und in Hamburg Videokameras, die mit Algorithmen und intelligenter Software verdächtige Bewegungsmuster finden sollen. Die KI muss dabei mit Daten und Bildern trainiert werden. Biometrische Daten werden nicht erfasst, auch Alter, Geschlecht oder Ethnie von Personen werden damit nicht bestimmt, wie die Hamburger Innenbehörde 2023 betont hatte.

Der Berliner KI-Koordindator beim Berliner LKA, Hofmann, nennt als ein mögliches Beispiel auch Fußballstadien, in denen mit Hilfe einer Gesichtserkennung etwa Randalierer ausgesiebt werden könnten. Eigene Datenmodelle dafür und andere KI-Systeme hat die Berliner Polizei aber nicht.

Im Zusammenhang mit Straftaten in der Silvesternacht hatte der stellvertretende Landesvorsitzende der Gewerkschaft der Polizei in Hamburg, Lars Osburg, vor kurzem gesagt: »Es ist nicht mehr zu vermitteln, warum wir massenhaft Kräfte zum Schutz von Veranstaltungen einsetzen müssen, aber auf die Chancen der KI bei der Fahndung nach bekannten Straftätern und Gefährdern verzichten.«

Experten befürchten mehr manipulierte Videos und Deepfakes

Die größte Gefahr in naher Zukunft sieht der Cybersicherheits-Experte Christian Dörr vom Hasso-Plattner-Institut in Potsdam aber darin, dass mit Hilfe Künstlicher Intelligenz zunehmend Deepfakes für Desinformationskampagnen eingesetzt werden. Dann spricht nicht der Kanzler im Video, sondern ein digitaler Zwilling.

Mit Hilfe von Manipulationen werde versucht, Wahlen zu beeinflussen und staatliche Systeme zu destabilisieren, meint Dörr. »Die großen Hackergruppen sind nationalstaatlich getrieben. Die haben natürlich auch sehr, sehr viel Interesse an KI.« Im Sommer 2022 hatte etwa die damalige Regierende Bürgermeisterin von Berlin, Franziska Giffey (SPD), per Video mit einer Person gesprochen, die wie der Kiewer Bürgermeister Vitali Klitschko aussah, aber nicht Klitschko war.

KI-Einsatz werden engen Grenze gesetzt

Für die Polizeiarbeit sind dem Einsatz von KI-Systemen aber auch enge Grenzen gesetzt. Bedenken gibt es, weil auch Risiken für unbescholtene Bürger gesehen werden und Grundrechte gefährdet sein können.

Der Bundesverfassungsschutz hatte bereits Regelungen in Hessen und Hamburg für verfassungswidrig erklärt. Es geht um eine Analyse-Software, mit der Polizisten mit einem Klick verschiedene Datenbanken durchsuchen, um in den riesigen Datenmengen Querverbindungen zu entdecken. Laut hessischer Polizei war im Zusammenhang mit einer Razzia gegen Reichsbürger so eine Festnahme gelungen. Im Dezember 2023 einigte sich nun die EU auf schärfere Regeln - das kann auch Folgen für KI-Instrumente bei der Polizei haben. »Wenn wir warten, bis Juristen einen wasserdichten Text haben, das dauert fünf Jahre«, meint der Berliner LKA-Beamte Hofmann.

© dpa-infocom, dpa:240107-99-516369/3